Cet article a été mis à jour pour la dernière fois le novembre 1, 2023

Table des matières

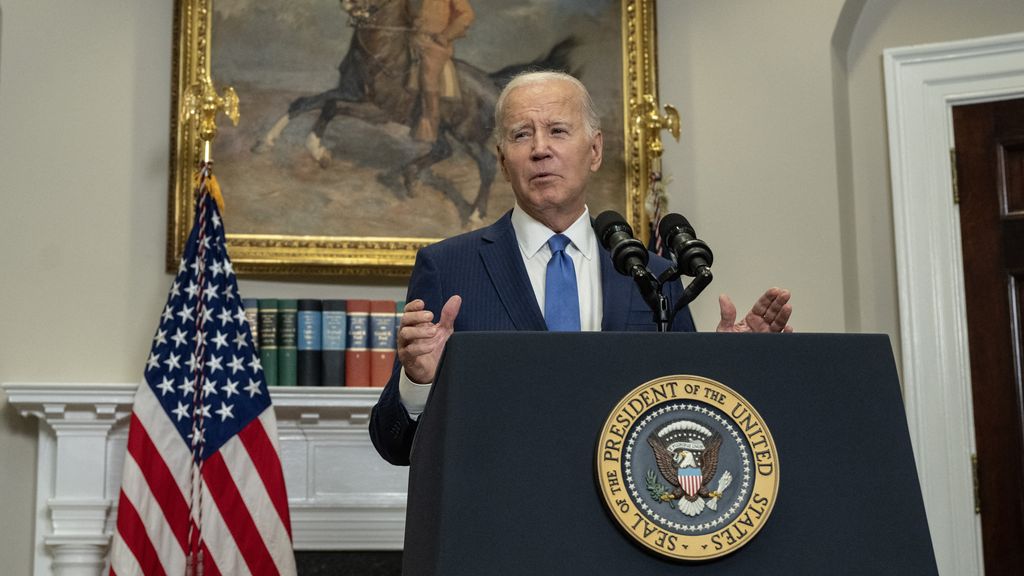

Le président Biden prend des mesures concernant les mesures de sécurité de l’IA

Les fabricants des « systèmes d’IA les plus puissants » aux États-Unis sont tenus de partager des tests de sécurité et d’autres « informations critiques » avec le gouvernement. Cela ressort clairement d’un décret présidentiel publié aujourd’hui par le président américain Biden.

Le décret de Biden fait partie d’une série de mesures par lesquelles le gouvernement américain tente de mieux contrôler l’IA (intelligence artificielle). Cela concerne spécifiquement les entreprises développant un système d’IA qui présente un « risque sérieux » pour la sécurité américaine. Le type de risque que cela implique n’est pas décrit. De plus, il n’est pas précisé qui détermine quand un tel risque existe.

Un décret présidentiel n’est pas une loi. Le président a besoin du Congrès pour cela. Biden appelle donc les parlementaires à proposer une législation.

IA de nouvelle génération

Un responsable gouvernemental anonyme souligne au Financial Times que le décret s’appliquera principalement à la prochaine génération de systèmes d’IA et non, par exemple, à GPT4, le moteur derrière la dernière version du générateur de texte avancé ChatGPT.

Même si les évolutions évoluent rapidement, la question est de savoir quand les entreprises devront se conformer à ces règles dans la pratique, ce qui suggère que les États-Unis ne veulent pas être trop sévères envers leurs propres entreprises avec ces nouvelles règles.

La Maison Blanche et les géants de la technologie discutent depuis un certain temps de l’IA. En juillet, les principaux acteurs de l’IA se sont connectés à des accords non contraignants. Cela incluait également la promesse qu’ils partageraient des informations sur la sécurité et la fiabilité de leurs systèmes. Avec la décision de Biden, cette absence d’obligation disparaît.

Filigrane pour le travail généré par l’IA

Outre les exigences imposées aux grandes entreprises technologiques, il s’agit également de développer un filigrane afin qu’il soit clair quand le travail a été généré par l’IA. Il y a ici une limite : cela ne sera utilisé que par le gouvernement fédéral, mais les entreprises ne sont pas obligées de l’adopter. Même si la Maison Blanche espère être un exemple pour les entreprises et les gouvernements du monde entier.

Il comprend également des mesures visant à protéger la vie privée des Américains, à promouvoir l’égalité, à protéger les droits des consommateurs, des patients et des étudiants, ainsi que des employés, entre autres. L’ordonnance garantit également que le gouvernement américain lui-même utilise l’IA de manière responsable et efficace.

Les mesures prises par l’administration Biden coïncident avec un code de conduite volontaire pour l’IA lancé par les pays du G7 et l’UE, a rapporté hier Reuters. Celui-ci expose la manière dont les grands pays souhaitent aborder l’IA, dans le contexte des préoccupations en matière de confidentialité et de sécurité.

Sommet sur l’IA au Royaume-Uni

Une réunion de deux jours sur l’IA débutera mercredi au Royaume-Uni, où sa sécurité sera centrale. Le vice-président Harris est là au nom des États-Unis. Le président de la Commission, Von der Leyen, est attendu au nom de l’UE et le secrétaire d’État Van Huffelen représentera les Pays-Bas. Une délégation chinoise est également attendue.

Mesures de sécurité de l’IA

Soyez le premier à commenter